Dans le monde de la data, le data wrangling est un peu le mot à la mode ces derniers temps. Nous vous en avons déjà proposé un aperçu général ici. Dans l’article d’aujourd’hui nous vous l’expliquons plus en détail et positionnons le data wrangling au sein du cycle de mise en valeur des données.

Sommaire

- Rappel sur le data wrangling

- Etape 1 : l’acquisition des données

- Etape 2 : le stockage des données

- Etape 3 : l’exploitation des données

Le data wrangling, c’est quoi ?

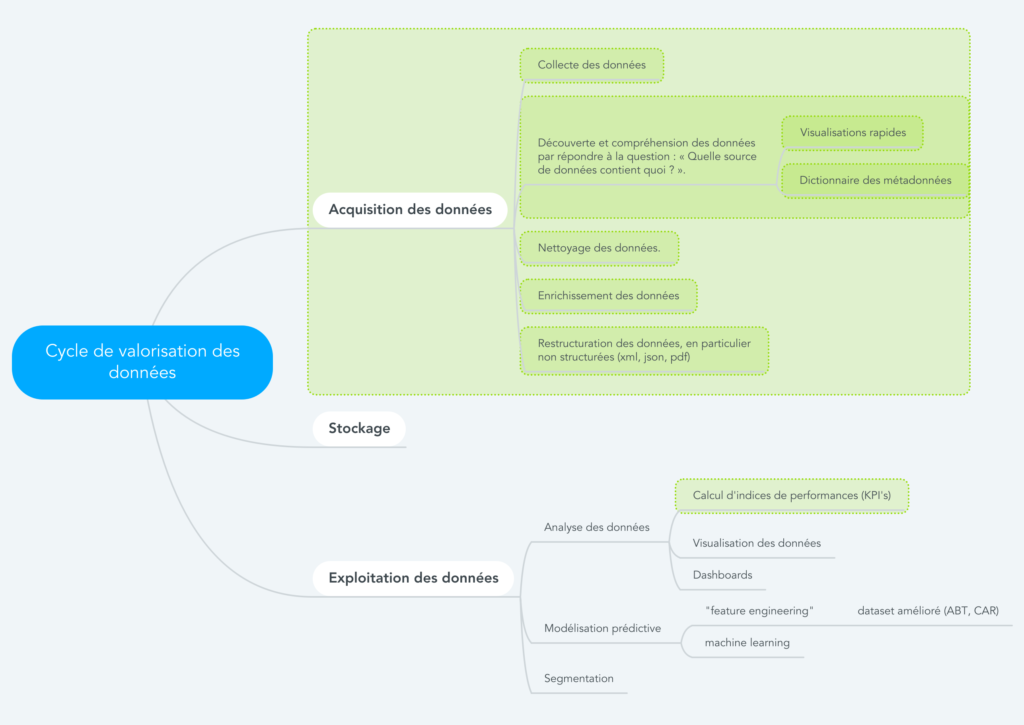

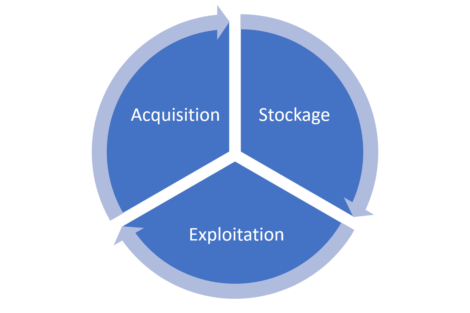

Le data wrangling est un terme qui désigne une série d’activités nécessaires pour valoriser les données. Ces activités sont en grande partie situées au niveau 1 (acquisition) du cycle de valorisation des données (schéma ci-dessous). Elles relèvent également, pour une petite part, de la partie 3 (exploitation).

La différence entre data wrangling d’une part, et data preparation / data exploration d’autre part est ténue. Le terme est surtout utilisé dans un contexte où les données sont « désordonnées » et les volumes importants.

L’utilisation commerciale du terme « data wrangling » est due à Trifacta. Pour marquer la différence avec data preparation / data exploration, Trifacta saupoudre le data wrangling d’intelligence artificielle. Mais ne soyons pas dupes. Il s’agit là d’un artifice commercial.

crédits : Shutterstock

ETAPE 1 : L’acquisition des données

L’acquisition des données est le cœur de l’activité de data wrangling. C’est à ce niveau que se déroulent les activités liées à la data preparation et la data exploration.

Collecte des données dans des sources diverses

Un des premiers challenges est de collecter l’information qui, aujourd’hui, est « éclatée » en une multitude de fichiers. L’expansion des données est telle qu’une étude récente estime à 52% les « dark data », les données qui ne sont même pas répertoriées par l’entreprise. Les fichiers peuvent être structurés (excel, csv, fichiers de tables relationnelles) ou non-structurés (XML, JSON, PDF). Ils peuvent provenir de l’intérieur de l’entreprise comme de l’extérieur.

Phase de découverte et compréhension des données

Durant cette étape on essaye de répondre à la question : « que contient chaque source de données ? ». Pour ce faire il est utile de disposer :

- d’un outil qui permet de faire rapidement quelques graphiques permettant de s’orienter visuellement dans les données (voir à cet effet mon classement des fonctionnalités importantes des ETL)

- d’un dictionnaire des métadonnées.

Nettoyage des données

Il est illusoire de penser que vos données seront directement « prêtes à l’emploi ». Il va falloir d’abord les nettoyer, s’assurer par exemple que la colonne « sexe » ne contienne bien que 3 valeurs différentes (homme, femme, inconnu) et pas une de plus.

Enrichissement des données

A l’heure du RGPD et de la suppression des cookies tiers, l’enrichissement des données se fait principalement en croisant des sources de données internes. L’enrichissement via des sources en « open data » est également intéressant.

Un exemple assez connu est le suivant. Une première table contient tous les clients avec leur prénom. Une seconde table est un dictionnaire des prénoms qui contient, pour chaque prénom, le sexe (disponible en open data ici). En croisant ces 2 tables sur base du prénom on pourra deviner le sexe du client.

A cette étape ou à la précédente (nettoyage des données), il peut être intéressant de recourir au fuzzy matching pour corriger les erreurs qui peuvent être présentes ici et là.

Restructuration des données

Si des données non structurées ont été utilisées (xml, json, pdf) il faudra les re-structurer (c’est-à-dire les mettre au format tabulaire).

crédits : Shutterstock

ETAPE 2 : Stockage des données

Une fois que les données collectées ont été nettoyées, structurées et enrichies, il est temps de les stocker dans un data lake (ou, historiquement, dans un data warehouse).

crédits : Shutterstock

ETAPE 3 : Exploitation des données du data lake

A quoi serviraient les données si on ne les exploitait pas ? C’est toute la finalité de la dernière étape du cycle de valorisation des données.

L’exploitation des données implique typiquement :

L’analyse des données

L’analyse des données peut se faire d’une part grâce à la visualisation, d’autre part grâce à l’identification d’indices de performances (KPI’s). Un bon graphique ou des KPI’s bien conçus permettront de mettre en évidence les processus qui sont en détériorations. Pour comprendre pourquoi un processus particulier se détériore (et y remédier), il faudra très souvent utiliser un modèle prédictif. Dans le data wrangling, on inclura la mise en place de KPI’s à des fins de monitoring.

La modélisation prédictive

La construction de ces modèles prédictifs implique :

Du « feature engineering » : il s’agit de créer les bonnes variables qui vont permettre d’obtenir des modèles prédictifs précis et robustes. A la fin de cette étape, on obtiendra un dataset « amélioré », encore appelé CAR ou ABT.

L’utilisation d’outil de « machine learning » (encore appelé plus récemment « outil AI ») qui analysent les variables à disposition pour en tirer des « modèles prédictifs ». Il s’agit d’observer les patterns récurrents dans le passé et d’en tirer les conclusions qui permettent de prédire le futur.

La segmentation

En marketing on aime bien les segmentations. Sauf que la plupart du temps elles ne reposent pas sur des comportements réels (observés) des consommateurs. C’est là que les données ont beaucoup de valeur car elles peuvent vous permettre de regrouper des clients suivant des variables auxquelles vous n’auriez pas pensé spontanément.

crédits : Shutterstock

En conclusion

Nous avons exposé les 3 grandes étapes du cycle de vie des données : acquisition, stockage, exploitation. Nous y avons replacé le concept de data wrangling.

Ces 3 étapes ne sont pas forcément séquentielles. En effet, lors de l’exécution de l’étape 3 (exploitation des données) il est très courant de découvrir :

- qu’il manque des données cruciales pour que les kpis calculés soient vraiment pertinents.

- qu’une partie des données collectée est corrompue ou invalide (par exemple : on effectue une jointure qui devrait fonctionner pour 100% de lignes et on se rend compte que les clés de jointures sont très souvent erronées ce qui induit des erreurs dans la jointure et que la jointure en question ne fonctionne que 20% du temps).

Quand cela arrive, il faudra revenir en arrière au point 1 pour collecter des données additionnelles nécessaires, ou simplement améliorer le processus d’extraction pour avoir des données de meilleure qualité. En pratique, bien souvent, au sein d’une même entreprise, il y a différentes équipes qui travaillent en parallèle sur chacune de ces étapes.

![Illustration de notre publication "Détecteurs d’IA générative gratuits : lesquels choisir ? [Test complet 2025]"](/blog/app/uploads/sherlock-holmes-120x90.webp)