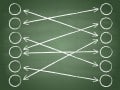

Het bestaan van filterbubbels (of kennisbubbels) is de centrale vraag die speelt bij Big Data en het ontwerpen van algoritmes. In de verschillende boeken die ik las over Big Data viel me vooral de sociologische leer van Dominique Cardon over de maatschappij waarin we leven op. In zijn boek “A quoi rêvent les algorithmes?” (Frans) stelt hij een leesrooster voor gebaseerd op 4 soorten webmetingen, elk op basis van een bepaald gegevenstype (zie hieronder het rooster, evenals de video onderaan dit artikel).

| Voorbeelden | Gegevens | Populatie | Berekeningsvorm | Principe | |

| Naast | Kijkcijfers, Google Analytics, reclameweergave | Views | Representatief monster | Stem | Populariteit |

| Boven | Page Rank de Google, Digg, Wikipedia | Links | Telling van stemmen, gemeenschappen | Meritocratisch klassement | Autoriteit |

| In | Aantal vrienden op Facebook, Retweet van Twitter, opmerkingen en adviezen | Likes | Sociaal netwerk, groep gelijken, verklarend | Benchmark | Reputatie |

| Onder | Aanbeveling Amazon, gedragsreclame | Traces | Impliciete individuele gedragingen | Machine Learning | Voorspelling |

Analyseschema van verschillende gegevenstypes en het gebruik ervan, volgens Dominique Cardon

Als aanvulling op de gedachten die ik ontwikkelde in eerder artikels over filterbubbels (Frans) stelde ik me de volgende vraag : « kan de classificatie van Dominique Cardon ook gebruikt worden om verschillende soorten filterbubbels van elkaar te onderscheiden?” Op die vraag probeer ik in dit artikel een antwoord te vinden.

“KAN DE CLASSIFICATIE VAN DOMINIQUE CARDON OOK GEBRUIKT WORDEN OM VERSCHILLENDE SOORTEN FILTERBUBBELS VAN ELKAAR TE ONDERSCHEIDEN”

1ste soort filterbubbel: gecreëerd door de grootte van het publiek

Volgens D. Cardon zijn “views” een gegevenstype dat wordt gebruikt om kijkcijfers te meten. De oorsprong van deze kijkcijfermeting ligt in de kijkcijfertelling van de media, die al vlug een beroep gingen doen op externe organisaties om de onpartijdigheid en correctheid van hun marktaandeel te meten. De plaats van de teller ligt dus « naast » de gegevens om het schema van D. Cardon te volgen. De teller geeft een meting van de populariteit van de producent van de gegevens op basis van het aantal gebruikers. De teller is onafhankelijk van de inhoud en de enige invloed op de inhoud komt dus van de producent zelf. Bij media zijn de journalist (en de redactieploeg) dus de gatekeepers. De gebruiker heeft de vrijheid om zijn gedrag aan te passen om niet ingekapseld te worden door een dominante mening, een overtuiging (doorgaans rechts tegen links) en om polarisatie te vermijden. Academische werkzaamheden bestaan er overigens in om de gebruiker online te confronteren met tegengestelde meningen. Daartoe werden de Amerikaanse media ingedeeld volgens hun politieke overtuiging (zie het werk van An et al. 2012) (Engels). We kunnen ons ook vragen stellen bij de polarisering van de media. Ook al zou journalistieke deontologie (de hoogste gatekeeper) boven de persoonlijke mening van de journalist moeten staan, toch kan niets een politieke kleuring vermijden. We herinneren ons de RAI in de jaren ’70, waarvan elke zender was toegewezen aan een onderliggende politieke stroming (RAI 3 volgde bijvoorbeeld de communistische lijn). De hoofdredacteur maakte ook bewuste keuzes op basis van de bedrijfsdoelstellingen door een redactionele lijn te bepalen. Zo vormde hij de mening die lezers, toehoorders of televisiekijkers over de wereld hebben.

2de soort filterbubbel: gecreëerd door hyperlinks

De links worden gebruikt als proxy autoriteit. Een bepaalde link geeft impliciet haar kwaliteit aan wat leidt tot het classificatie-algoritme. Het probleem is de predominantie van de eerste pagina van wat wordt geconsumeerd.

Zelfs al is het zo dat veel pagina’s niet relevant zijn (omdat ze fouten bevatten en dus achteraan liggen) kan men zich vragen stellen bij de verschillen in informatiekwaliteit tussen de 10 eerste en de 10 volgende pagina’s. Wel, slechts 8,5% van de surfers gaan naar de tweede pagina van de Google-resultaten (Engels) en nog minder (1,1%) (Engels) gaan naar de 3de pagina. Omdat het algoritme van Google (PageRank) zelflerend is (als ik op een link klik en vervolgens naar de resultatenpagina terugkeer, plaatst Google de positie van de link lager omdat ze minder relevant wordt geacht dan wanneer ik niet naar de resultatenpagina zou terugkeren) leidt het gebruiksgedrag van de surfer tot klassering van de links. Zo kan een kort artikel, dat makkelijk te lezen is maar vol fouten zit en niet objectief is, hoger geklasseerd staan dan een lang en grondig artikel dat weliswaar moeilijk te lezen is en dus alleen surfers aantrekt die gemotiveerd zijn voor moeilijke lectuur. Het is op die manier dat onze maatschappij ongemerkt afglijdt naar middelmatigheid, zoals ik al beschreef in een artikel, dat zowel tot kritiek als naar erkenning leidde.

3de soort filterbubbels: gecreëerd door de sociale gatekeepers (= de beïnvloeders)

Omdat de mate van autoriteit nu geïntegreerd is binnen de websites (retweets op Twitter, likes op Facebook, foto’s herbenoemd op Pinterest, checks op Foursquare, …) moet men zich vragen stellen bij de rol van beïnvloeders die deze nieuwe meting weten te gebruiken om zich sociaal te profileren en zich een virtueel imago en virtuele reputatie aan te meten.

Een studie over sz polarisatie van views op Twitter geeft duidelijk de invloed die sommigen, op knooppunten van het sociale netwerk, kunnen hebben op de verspreiding van ideeën (Engels), waarmee onze eigen overtuigen in vraag kunnen worden gesteld. Het is ook interessant om het gewicht van deze beïnvloeders na te gaan betreffende de verspreiding van ideeën, ongeacht welke overtuiging, en te zien dat retweets, de hedendaagse proxy van mond-tot-mond reclame, door een minderheid wordt gedaan. Twitter is dus helemaal geen democratisch medium waar elke stem telt. Het is een meritocratie waar beroemdheid, excessen, een bepaald statuut opleveren: dat van zijn stem te laten horen (het signaal) tussen het geroezemoes (het digitale geluid).

4de soort filterbubbel: gecreëerd door ons eigen gedrag

Zoals Dominique Cardon terecht aanhaalt, « voorspellen » algoritmes de toekomst vanuit het verleden door de helling van de eerdere gedragingen te verlengen. Het is wellicht die opvatting van de toekomst die Eli Pariser (Engels) heeft geïnspireerd bij de uitvinding van de term “filterbubbel”. Eén van de vele voorbeelden hievan is Netflix, dat een volgende film aanraadt op basis van wat eerder werd bekeken (lees hierover mijn artikel over de RecSys conferentie 2016). Deze manier om de toekomst te programmeren doet onze toekomst afhangen van ons verleden, hoe middelmatig het ook is, en doet ons afglijden naar de middelmatigheid van de troost. De kleinste afglijding (bijvoorbeeld het kijken naar « gemakkelijke inhoud ») wordt benadrukt en onze menselijke zwaktes worden slinks uitgebuit om ons langzaam maar zeker te doen overhellen naar de gladde helling van de middelmatigheid. Er is geen gatekeeper meer. Het algoritme levert ons over aan onze zwaktes. Er is geen externe mening meer om ons hoofd boven water te houden en ons opnieuw uit te dagen als de programmeur van het algoritme dat zo niet heeft gewild. Dit alles berust natuurlijk op de kwestie van ethiek en Big Data, waarbij sommigen erin slagen om bevredigende antwoorden te vinden (zie het voorbeeld van Meetup.com)

Conclusie over de verschillende filterbubbels: de rol van gatekeeper

Met het leesrooster voorgesteld door Dominique Cardon kan vastgesteld worden dat elk soort van gegeven (views, links, likes, traces) haar eigen superieure matrix, haar eigen filterbubbel creëert. Het verschil zit niet zozeer in het soort gebruikte gegevens, maar in de rol die de gatekeeper krijgt: bestaat hij of niet, heeft hij aanzienlijke beslissingsmacht over wat de gebruiker consumeert, heeft hij goede of slechte bedoelingen, is hij onderhevig aan deontologische regels of niet ? Tal van vragen die gesteld moeten worden om het gevaar van elk exploitatiemodel in te schatten. Laten we ons aan de hand van deze nieuwe lezing vragen stellen bij elk van de 4 modellen.

In het eerste model (“naast) worden “views” gebruikt door een onafhankelijke autoriteit, gekend en erkend door iedereen, om de producenten van inhoud onderling in te delen. Elke producent gehoorzaamt aan min of meer strikte regels om zich naar zijn gebruikers te richten en te proberen een deel van de markt te veroveren. Er zijn evenveel gatekeepers als producenten en deze producenten volgen bepaalde regels (bijvoorbeeld de journalistieke code) zodat ze op gelijke voet staan. Uiteindelijk is elke gebruiker vrij om zich, al dan niet, aan te sluiten bij de mening van elke producent en te veranderen als hij niet akkoord gaat. In dit model is er geen monopolie van overtuiging. Zo zijn de mechanismes van gatekeeping in het eerste model aanwezig op verschillende niveaus en zijn de regels die de handelingen van de verschillende actoren regelen gekend.

In het tweede model (“boven”) worden hyperlinks gebruikt als een proxy autoriteit en wordt het aantal gatekeepers door de monopoliesituatie van Google tot één gereduceerd. Alleen een gewaarschuwd gebruiker kan van gatekeeper veranderen door een andere zoekmotor te gebruiken (bijvoorbeeld TOR) met soms meer arbitraire resultaten die voor de surfer minder kwaliteitsvol kunnen zijn. De macht concentreert zich dus bij een enkele gatekeeper die daardoor zijn mening kan opleggen, de regels (het algoritme) kan veranderen zonder dat iemand te laten weten. De macht van webmasters is te gefractioneerd macht om een dergelijke invloed uit te oefenen.

In het derde model (“in”) zijn de gatekeepers de knoop van het sociale netwerk. Ze zijn talrijker aanwezig dan in het tweede model, maar veel van de macht blijft in enkele handen. Die macht kan dus op meer transparante manier ten gelde worden gemaakt om het juiste digitale woord te propageren (dit zijn bijvoorbeeld de vloggers en andere beroemde youtubers die hun virtuele beroemdheid ten dienste stellen van merken die hun bekendheid willen verhogen).

In het vierde model (“boven”) wordt het individu zijn eigen gatekeeper. Zijn gedrag, met zwaktes en gewoontes, wordt de directe lijn naar zijn toekomst. Er bestaat naast het algoritme geen hogere autoriteit meer die gedragingen beslist, voorstelt en versterkt die soms schadelijk kunnen zijn voor het individu zelf. Ik heb me vragen gesteld bij de gevaren van verslaving die de aanbevelingsalgoritmes van Netflix kunnen inhouden; hetzelfde kan gesteld worden bij algoritmes die televerkopers van Nespresso aanbevelen om meer koffie te verkopen aan iemand die al te veel koffie drinkt of bij een bankbediende die u producten voorstelt die u niet echt nodig heb (dat is het algoritme om een product aan te bevelen aan diegenen die er het minste profijt aan hebben, waardoor de kosten van de bank dalen en de winsten stijgen).

Photo : Shutterstock

![Illustratie van onze post "Betaal de juiste prijs voor je koffie bij Albert Heijn [Nudge Marketing]"](/blog/app/uploads/true-price-albert-heijn-4-120x90.webp)