Les algorithmes de recommandation promettent aux marketeurs de réaliser leur Graal : celui de relations personnalisées avec tous leurs clients à un prix raisonnable. La qualité de la relation client étant un facteur décisif pour la satisfaction client et la fidélisation, les recommandations algorithmiques représentent donc la promesse d’interactions de qualité avec les clients et d’actions marketing pleines de sens.

La personnalisation à grande échelle ne peut toutefois se faire qu’en utilisant les données clients et les traces numériques que ces derniers laissent derrière eux. Dans un monde où la sensibilité à la vie privée se développe (RGPD) et où le cadre légal se renforce (e-privacy), comment réconcilier les clients en quête de sens et des entreprises en quête d’économies d’échelle ?

C’est la question que je vous propose d’étudier dans l’article d’aujourd’hui. Cet article servira de support à mon intervention lors du congrès BAM les 5 et 6 Décembre 2019 à Bruxelles (voir présentation ci-dessous).

Sommaire

- La personnalisation à grande échelle est un facteur essentiel de succès des entreprises

- Le développement de la sensibilité à la protection des données personnelles

- La personnalisation de la relation client : un rêve de marketeur

- 4 points d’action pour gagner la confiance de vos clients

- Conclusions

Quelques chiffres sur les effets de la personnalisation

La recommandation algorithmique est utilisée aujourd’hui de manière massive pour permettre la personnalisation des interactions clients à grande échelle. Elle a investi tous les secteurs d’activités en B2C et son efficacité n’est plus à démontrer. Voici quelques chiffres :

- Netflix a près de 160 millions d’abonnés dans 190 pays. 80% de la consommation sur la plateforme provient de recommandations algorithmiques.

- Netflix réalise 1 milliard d’Euros de gain chaque année grâce à la personnalisation algorithmique. La personnalisation permet de réduire le churn (source: Techjury).

- 35% des achats sur Amazon sont le fait des recommandations algorithmiques : « les clients qui ont acheté ceci ont aussi acheté cela » (source : McKinsey).

- Alibaba a augmenté ses ventes de 20% en personnalisant les landing pages de son site (source : Alizila).

- 500 heures de contenu sont uploadées chaque minute sur YouTube et la consommation de vidéos online a doublé chez les enfants en 4 ans. Dans le même temps 70% de la consommation sur YouTube provient de l’algorithme de recommandation (sources : CNet, Tubefilter, Washington Post)

- 100% des résultats proposés par Google sont personnalisés. C’est l’algorithme de personnalisation le plus utilisé au monde.

Le respect de la vie privée

Déjà en 2017 un sondage révélait que seulement 10% des citoyens américains estimaient avoir le contrôle complet de leurs données personnelles. En outre ils n’étaient que 25% à faire confiance aux entreprises pour protéger leurs données personnelles. Les scandales à répétition (Cambridge Analytica) n’auront rien arrangé, d’autant que l’entrée en vigueur du RGPD aura entraîné une sensibilisation supplémentaire de l’opinion publique au respect de la protection des données personnelles.

On assiste aussi à la multiplication des législations ou des tentatives de régulation sur des sujets connexes : bulles de filtres, transparence des algorithmes, addictions digitales, … On ne peut pas dire que nos élus chôment. Le respect de la vie privée semble les motiver.

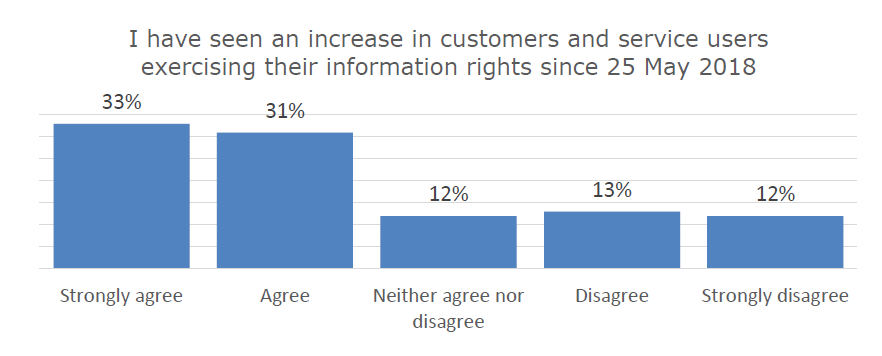

64% des entreprises anglaises ont noté une augmentation des plaintes après l’entrée en vigueur du RGPD

On peut donc s’attendre à ce que cette sensibilité exacerbée de tous côtés se reflète dans les demandes en relation avec la protection des données personnelles reçues par les entreprises. Une enquête réalisée en mars 2019 par l’ICO (autorité de contrôle Royaume-Uni) nous éclaire sur le sujet. Depuis l’entrée en vigueur du RGPD, 64% des entreprises anglaises ont l’impression que les consommateurs portent plus souvent plainte pour protéger leurs données (source : enquête mars 2019, rapport annuel 2018/2019 de l’ICO).

La question reste toutefois de savoir si cette impression est conforme à la réalité et surtout si cette impression vaut pour les autres pays de l’Union Européenne. Une étude réalisée par IntoTheMinds auprès des autorités de protection des données de l’Union Européenne a permis de collecter des données précises pour 17 pays sur l’effet du RGPD. Il résulte que l’augmentation moyenne du nombre de plaintes reçues par les autorités de contrôle des 17 pays étudiés entre 2017 et 2018 est de +109% ou 2037 plaintes.

Les résultats détaillés sont accessibles ci-dessous.

| Pays | Augmentation du nombres de plaintes relatives aux données personnelles après l’entrée en vigueur du RGPD (en %, année 2018 comparée à 2017, du 1er Janvier au 31 Décembre de chaque année) | Augmentation du nombres de plaintes relatives aux données personnelles après l’entrée en vigueur du RGPD (en nombre de plaintes, année 2018 comparée à 2017, du 1er Janvier au 31 Décembre de chaque année) |

| Islande | -3% | -3 |

| Croatie | +257% | +3527 |

| Slovaquie | +54% | +32 |

| Lettonie | +39% | +346 |

| Chypre | +45% | +154 |

| Royaume-Uni | +98% | +20642 |

| Norvège | +56% | +123 |

| Danemark | +149% | +3302 |

| Lituanie | +79% | +379 |

| Roumanie | +36% | +1279 |

| Luxembourg | +125% | +250 |

| Suède | +480% | +1180 |

| Irlande | +45% | +1240 |

| Liechtenstein | +270% | +1465 |

| Hongrie | +22% | +177 |

| Slovénie | +43% | +242 |

| Bulgarie | +65% | +308 |

On constate que les chiffres reflètent des réalités très disparates. Certains pays voient des augmentations majeures. Mais à part le Royaume-Uni qui enregistre des volumes élevés de plaintes (ce qui explique les réponses des DPO anglais au sondage mentionné par l’ICO), en chiffres absolus les volumes de plaintes restent relativement modestes. Ramenés à la population des pays concernés, on peut même estimer qu’ils sont insignifiants. En moyenne, en 2018, ce sont en effet moins de 5 personnes sur 10000 qui ont adressé une plainte concernant leurs données personnelles.

Moins de 5 personnes sur 10000 ont adressé une plainte concernant leurs données personnelles en 2018

Il convient donc de relativiser ce que j’avançais au début de ce paragraphe. Malgré tous les efforts faits pour sensibiliser les foules à l’importance de leurs données personnelles, il semble que le message ait encore du mal à passer. Les traces numériques laissées lors de nos activités digitales sont très largement négligées, leur importance incomprise, et les citoyens ne s’y intéressent donc pas vraiment. Si le RGPD a popularisé la notion de « privacy-by-design », j’aime à dire que ce règlement a été conçu avec « flaw-by-design ». Son défaut de conception c’est le principe du consentement, un talon d’Achille sur lequel nous reviendrons plus tard.

La relation personnalisée, un rêve de marketeur

Le développement de relations personnalisées avec ses clients est le rêve de toute entreprise. En effet une relation de qualité, personnalisée, permet de fidéliser le client. Et comme chacun sait, une fidélisation accrue entraîne une amélioration de la rentabilité. Entretenir des relations personnalisées a un coût. Ce coût est supportable lorsque vous avez peu de clients (en B2B par exemple). Mais comment personnaliser à grande échelle ? La personnalisation algorithmique à grande échelle a été permise par les algorithmes et par la collecte de données clients en quantités encore jamais vue. La démocratisation du stockage de données et des capacités de calcul (merci Amazon) promet dès lors de personnaliser chaque relation client à moindre coût.

En 2015, 39,7% des Américains déclaraient ne pas vouloir de personnalisation

Là encore il existe toutefois une contradiction. Dans une étude américaine publiée en 2015, les répondants ont été 39,7% à déclarer ne pas vouloir de personnalisation et seulement 6,2% réclamaient une personnalisation « extrême ». Est-ce une volonté véritable des consommateurs de garder leur libre-arbitre dans leurs choix ? Ou bien s’agit-il simplement d’une méconnaissance des mécanismes déjà à l’œuvre (mais invisibles) dans tous les aspects de leur vie quotidienne ? La question est posée mais il y a fort à parier que la deuxième option est la plus probable. Les consommateurs ne sont tout simplement pas conscients de l’utilisation des algorithmes de personnalisation sur tous les sites qu’ils fréquentent, dans toutes les applications qu’ils utilisent.

Il y a donc un problème qu’il nous faut résoudre pour gagner la confiance du consommateur. Ceci nous amène donc à la quatrième et dernière partie de cet article.

Comment bâtir la confiance avec le client dans des interactions basées sur ses données

La sécurité des données est un élément de base à la confiance. Je ne vais donc même pas l’aborder puisqu’il s’agit d’un prérequis. Faites en sorte de répondre à la norme ISO 27001 et vous devriez normalement être bien armé pour vous concentrer sur les actions suivantes.

Action 1 : éduquez, simplement

En 2018 j’ai réalisé une étude sur les politiques de confidentialité et en ai réalisé une autre sur les 20 sites web et applications les plus utilisés. Il fallait entre 30 minutes (Pinterest) et 51 minutes (Whatsapp) pour lire les politiques de confidentialité. Au rythme de 120 mots efficaces par minute, la lecture des textes légaux de ces 20 sites prenait plus de 11 heures. 56% des internautes acceptent les conditions d’utilisation des sites sans les lire (source). Le « consentement » étant le talon d’Achille du GDPR, les entreprises ont dès lors beau jeu de faire ce qu’elles veulent avec vos données puisque vous y avez consenti. Alors, on peut raisonnablement estimer qu’il faut simplifier la tâche de l’internaute et l’éduquer. Ce faisant, vous prendrez à contre-pied vos concurrents et gagnerez le respect de vos utilisateurs. Ces derniers développeront en parallèle une conscience plus aiguë de la protection de leurs données personnelles, ce qui ne pourra que vous profiter.

Il faut entre 30 minutes (Pinterest) et 51 minutes (Whatsapp) pour lire les politiques de confidentialité des applications que nous utilisons au quotidien

Comment faire concrètement ? J’aimerais vous donner l’exemple de la RTBF pour laquelle j’ai travaillé de 2015 à 2019. Je suis notamment à l’origine d’une vidéo tournée avec le présentateur belge Adrien Devyver qui explique en quelques séquences simples ce que la RTBF fait avec les données de ses utilisateurs. Il s’agit d’un moyen ludique et simple de faire passer un message parfois compliqué.

Action 2 : redonnez le contrôle aux utilisateurs

Les algorithmes de personnalisation sont par essence des mécanismes opaques. Donner la possibilité au client de les manipuler permet de redonner confiance sur leur fonctionnement. Depuis l’entrée en vigueur du RGPD on assiste à l’éclosion d’initiatives qui vont dans le bon sens. J’ai parlé des efforts de YouTube qui permet désormais d’effacer ou de suspendre l’historique de consommation. D’autres initiatives existent, comme celle réalisée à partir de l’interface de Spotify par Nava Tintarev et ses collègues, et présentée lors de la conférence RecSys 2018.

Action 3 : arrêtez d’utiliser les données des autres

Depuis des années j’appelle à la construction de la « data souveraineté« . Les entreprises doivent devenir autonomes dans la gestion de leurs données et ne plus dépendre de tiers pour le profilage de leurs clients ou utilisateurs. Ce principe a été appliqué par plusieurs de nos clients (dont la RTBF dès 2016 avec le lancement de son login unique). Avec le recul, tout le monde se félicite de ce choix. Le contrôle des données est meilleur, les risques de fuite sont contenus. Surtout, l’entreprise conserve une vue 360 sur les données des clients et peut répondre avec certitude à toutes leurs demandes.

Une conséquence logique de ces choix, c’est que les données clients ne peuvent pas être revendues. Si votre stratégie est de ne compter que sur vos données de première partie (1st-party data), il est hors de question de revendre ces dernières. Ce serait incohérent avec la promesse faite à l’utilisateur et bien entendu cela mettrait en péril la confiance qu’il a placée en vous.

Action 4 : construisez la confiance petit à petit

Il n’est pas possible de récolter toutes les données nécessaires à une fine personnalisation en une fois. D’abord le RGPD vous en empêche (puisqu’il faut une finalité précise à la collecte des données). Ensuite, récolter des données sans justification mettrait là encore à mal la confiance des clients dans votre entreprise. Quelle est la solution ? Nous en avons déjà parlé dans un autre article. Il faut identifier les contextes et les situations qui incitent l’utilisateur à vous en dire plus sur lui.

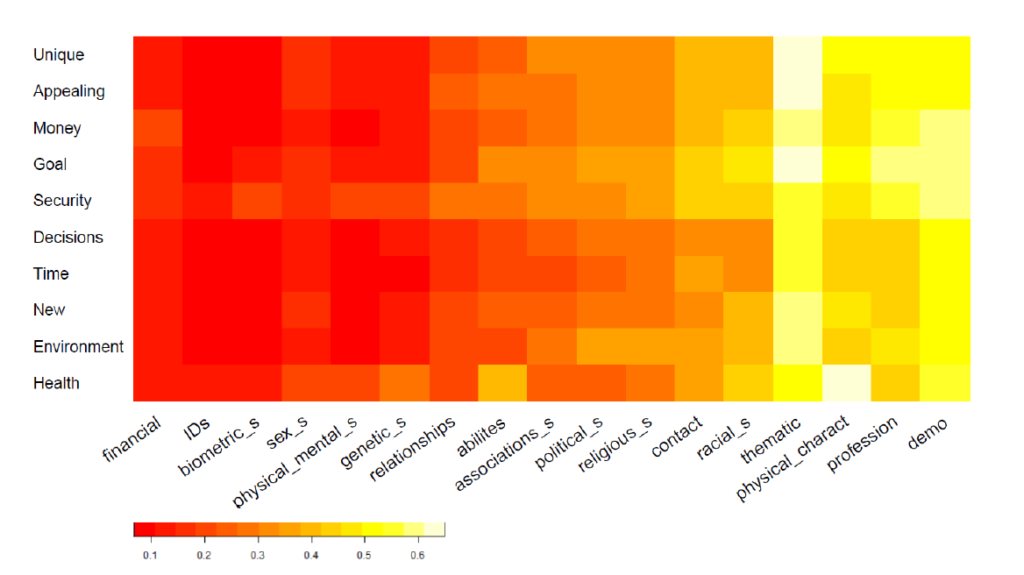

L’étude de Wadle et al. (2019) analyse 17 catégories de données et 10 contextes différents. Alors que certains types de données (centres d’intérêt ou socio-démographie) sont partagés facilement quel que soit le contexte, d’autres ne pourront l’être que dans des situations précises. C’est le cas des données biométriques par exemple dont la probabilité de partage n’augmente que dans un contexte d’amélioration de la sécurité.

En conclusion

Dans cet article nous avons donc vu que la personnalisation à grande échelle imposait l’utilisation d’algorithmes de recommandation. Ces derniers ne peuvent fonctionner qu’avec des données clients. Or les clients sont de plus en plus méfiants en ce qui concerne le partage de données personnelles, même si cette méfiance ne se traduit pas encore dans les plaintes aux autorités de protection de la vie privée. Il faut donc mettre en place une stratégie permettant d’instaurer la confiance nécessaire à la transmission de données personnelles.

4 points d’action ont été proposés :

- éduquer de manière ludique au fonctionnement de l’algorithme

- donner des moyens de contrôle sur la personnalisation à l’utilisateur

- n’utiliser que des données que vous avez collectées vous-même (données de 1ère partie)

- définir des contextes précis, stratégiques, pour la collecte de données supplémentaires

Des questions, des remarques, une demande ? N’hésitez pas à nous contacter. Nous sommes là pour vous aider.

![Illustration de notre publication "Linkedin reste sous-utilisé par les directeurs marketing [Etude]"](/blog/app/uploads/linkedin-logo-120x90.jpg)