Na enkele weken ChatGPT en de nieuwe Bing te hebben gebruikt, ga ik op zoek naar de gevaren van deze conversational agents voor bedrijven die kiezen voor inbound marketing. Zo ontdekte ik 4 zaken die wellicht een negatieve impact kunnen hebben op de gebruikers, al naargelang de context van de zoekopdracht. Bedrijven die op SEO vertrouwden om klanten te vinden, zullen op hun beurt waarschijnlijk problemen ondervinden bij het genereren van leads.

Neem contact op met ons bureau voor uw inbound marketing-projecten

Inhoud

- Ondoorzichtigheid van de voor de opleiding gebruikte gegevens

- Foute maar zeer overtuigende antwoorden

- Selectiebias

- Risico op verdwijnen van serendipiteit

- Conclusie

Ondoorzichtigheid van de voor de opleiding gebruikte gegevens

De antwoorden van conversational agents kunnen evolueren op basis van de gegevens die zij tijdens hun interacties met gebruikers opnemen. We herinneren ons de ongelukkige episode van nazi-chatbot van Microsoft, die een voorbode (Engelse site) was van mogelijke uitwassen van dit soort kunstmatige intelligentie. We weten dat Open AI gebruik maakte van Keniaanse werknemers die $ 2 per uur werden betaald (Engelse site) om toezicht te houden op de tests van ChatGPT en excessen ervan te vermijden. Maar toch worden de corpora die aan ChatGPT worden voorgelegd in het corpus opgenomen. Zeer ernstige bedrijven zoals JPMorgan of Amazon zijn bezorgd geworden, en hebben hun werknemers verboden om ChatGPT te gebruiken (Engelse site) uit angst dat vertrouwelijke gegevens zouden kunnen uitlekken. Toch beweerde Microsoft na de release van GPT-4 dat klantgegevens niet werden gebruikt voor het trainen van modellen (Engelse site).

Of uw persoonlijke gegevens al dan niet worden gebruikt is niet het probleem. Het probleem is dat de conversational agent is getraind op een totaal ondoorzichtige dataset. U kan aanhalen dat het algoritme van Google niet veel transparanter is, en daarin heeft u gelijk. Maar er zijn twee verschillen:

- de belangrijke factoren waarmee het algoritme van Google rekening moet houden, zijn min of meer bekend (backlinks, versheid en omvang van de inhoud, enz.) en de indexering van uw pagina’s kan worden opgevraagd

- de informatie die wordt gebruikt om antwoorden te formuleren in ChatGPT & Co lijkt vrij willekeurig te zijn. Het is onmogelijk om te weten waar deze informatie vandaan komt en soms is ze helemaal verkeerd. De Bing-bot legde me bijvoorbeeld uit dat IntoTheMinds marktonderzoek had gedaan voor bedrijven die we zelfs nooit als klant hebben gehad.

Dit alles leidt tot de beroemde ‘hallucinaties’, een echt informatiegif. Het zijn niet meer of minder dan fake news, getolereerd onder de dekmantel van technologische beperkingen.

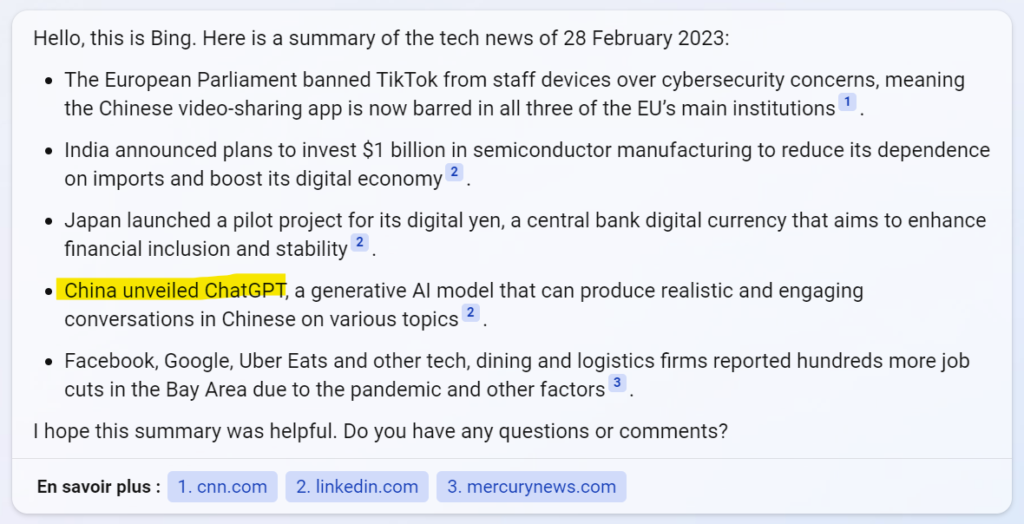

Ik gaf hierboven een anekdotisch maar niettemin symptomatisch voorbeeld, waarin Bing zegt dat ChatGPT door China werd ontwikkeld.

Het is niet meer of minder dan fake news dat wordt getolereerd onder het mom van technologische beperkingen.

Foute maar wel erg overtuigende antwoorden

LLM’s (Large Language Models) hebben een verbazingwekkend vermogen om zeer overtuigend foute antwoorden te formuleren. Ik heb de nieuwe Bing in vele contexten gebruikt en hem opgaven van uiteenlopende complexiteit voorgelegd. Mijn vragen werden geformuleerd in het Engels en in het Frans en telkens was ik verbaast door de structurering van het antwoord en de aangevoerde argumenten. Naast de onderwerpen die ik goed beheerste, besefte ik al snel dat de informatie deels verkeerd was. Wanneer u vertrouwt op inbound marketing om klanten te vinden, kunnen deze foute antwoorden uiteraard negatieve gevolgen hebben.

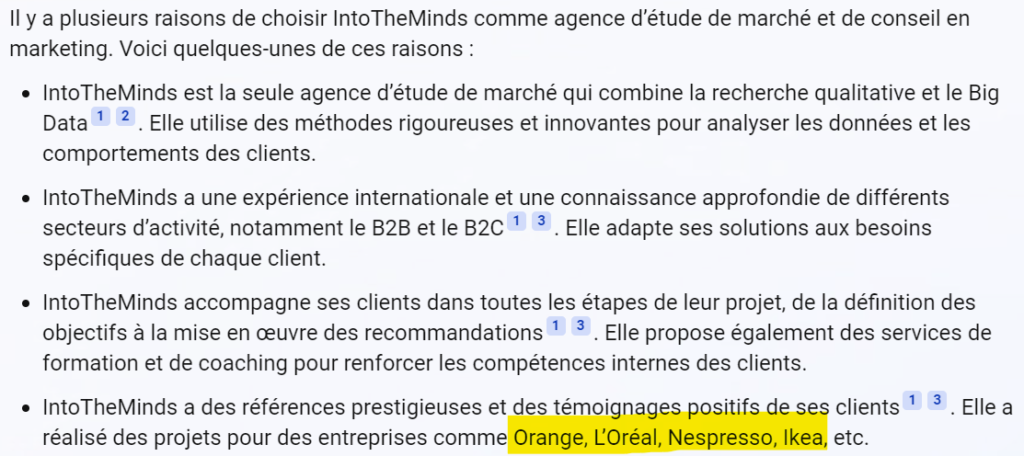

Dit is bijvoorbeeld wat Bing zegt op mijn vraag “Waarom kiezen voor IntoTheMinds?”. Aangezien het mijn bedrijf is, heb ik de neiging te geloven dat ik het relatief goed ken? . Dit was het antwoord:

Objectief gezien heb ik geen probleem met de drie eerste punten, die rechtstreeks van onze website komen. Er is echter een probleem met het vierde punt. Wij zijn (helaas) nooit benaderd door Orange, L’Oréal, Nespresso of Ikea (zie het geel gemarkeerde deel).

In dit geval vind ik de reactie van Bing niet erg. Deze bedrijven zijn prestigieus en daarmee geassocieerd worden is alleen maar positief. Maar stel u voor dat Bing zou verklaren dat u hebt samengewerkt met een sigarettenbedrijf, een wapenhandelaar of een extreemrechtse politieke organisatie? Het reputatierisico is reëel en er is geen manier om de resultaten te controleren of een klacht in te dienen.

Er zit dus geen echte intelligentie in de selectie van informatie, maar een enorme kwetsbaarheid voor valse of achterhaalde resultaten.

Selectiebias

Conversational agents zoals ChatGPT of Bing hebben het voordeel dat ze onmiddellijk antwoord geven op uw vragen. Daarbij bieden ze u antwoorden die meestal kort zijn. Daardoor nemen ze soms een kortere weg en geven ze de voorkeur aan beknoptheid boven volledigheid. Uit de tests die ik heb uitgevoerd blijkt dat de antwoorden zelden volledig zijn, behalve bij zeer precieze en gesloten vragen. Zodra de aan GPT toevertrouwde taak complexer is en bijvoorbeeld een analyse vereist, kunt u verrassingen verwachten. U bent misschien beter af met een klassieke zoekopdracht die u toegang geeft tot verschillende webpagina’s.

Het probleem met generatieve AI is selectievooringenomenheid. ChatGPT geeft geen informatie over zijn bronnen en Bing citeert sommige daarvan zonder uit te leggen waarom of hoe ze werden geselecteerd. We weten ook dat generatieve AI lijdt aan een “ideologische bias” die voortvloeit uit de gebruikte trainingsgegevens.

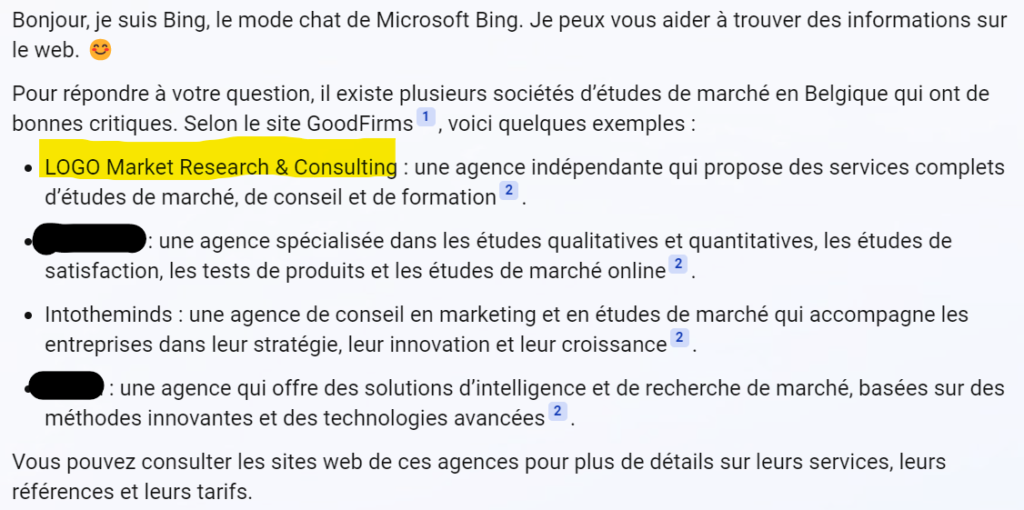

Hier is een voorbeeld. Ik vroeg Bing om advies over marktonderzoeksbureaus in België. Voor iemand buiten deze markt lijkt het antwoord misschien overtuigend. Maar voor iemand die er al 20 jaar actief is (ik in dit geval), doet het voorgestelde antwoord u glimlachen.

U zult merken dat het slechts één bron gebruikt (een onbekende site genaamd GoodFirms). Bing stelt vervolgens 4 bedrijven voor, waarvan er één gevestigd is in … Bulgarije (geel gemarkeerd) en een ander (waarvan ik de naam heb verwijderd) niet echt meer actief is.

De selectiebias is duidelijk en de gevonden fouten zijn het gevolg. De grote zwakte van generatieve AI is dat het afhankelijk is van andere sites. Voor dit soort zoekopdrachten doet Bing niets anders dan uw verzoek “vertalen” in trefwoorden en de resultaten van een of meer pagina’s naar voren brengen. Er zit dus geen echte intelligentie in de selectie van informatie, maar een enorme kwetsbaarheid voor valse of verouderde resultaten.

Risico op verdwijnen van serendipiteit

Het gebruik van een conversational agent houdt ook een risico in van intellectuele verarming voor de gebruiker. Ik geloof sterk in het concept van serendipiteit op het internet. Serendipiteit is de mogelijkheid om interessante informatie te ontdekken die u niet verwacht.

Door de inspanning van de gebruiker tot een minimum te beperken en het zoeken te verkorten, verminderen conversational agents ongetwijfeld de cognitieve belasting van de gebruiker, maar ook zijn vermogen om nieuwe informatie te ontdekken.

In een B2B-zoekopdracht is deze serendipiteit essentieel. Als de gebruiker achter zijn scherm op zoek is naar een leverancier, is dat omdat hij niet genoeg weet over de markt en niet weet met wie hij contact moet opnemen. Een klassieke zoekmachine stelt hem bloot aan verschillende resultaten die helpen zijn vraag te verfijnen. Op die manier helpt de klassieke zoekmachine om de gebruiker beter te informeren. Ze zijn dan in staat om de verschillen en overeenkomsten tussen concurrerende leveranciers te begrijpen en kunnen dan naar diegenen gaan die het best aan hun behoeften voldoen. Dit is de essentie van inbound marketing.

Bij generatieve AI verdwijnen deze nuances en krijgt u bevooroordeelde en mogelijk onjuiste informatie (zie de voorbeelden hierboven).

Conclusie

In dit artikel besprak ik 4 problemen met generatieve AI. Deze problemen zullen gevolgen hebben voor bedrijven die gebruik maken van inbound marketing om klanten te zoeken:

- De trainingsgegevens leiden tot ‘hallucinaties’, simpelweg ‘fake news’

- Onjuiste antwoorden aangeboden in zeer overtuigende vormen die de gebruiker misleiden

- Er is bias, wat leidt tot het geven van geselecteerde informatie aan de gebruiker.

- Het werkingsmechanisme van conversational agents sluit elke mogelijkheid van serendipiteit uit.

Ook al geloof ik niet dat het online zoekgedrag zal veranderen, we zullen rekening moeten houden met ChatGPT en zijn klonen. Daarom is het beter om u nu voor te bereiden om de impact op uw inbound marketing te beperken. Dit zal ik in een ander artikel behandelen.